Avrupa Birliği Yapay Zekâ Yasası Analizi

Avrupa Birliği Yapay Zekâ Yasası (AI Act), yapay zekâ teknolojilerinin gelişimini ve toplumsal etkilerini düzenlemeye yönelik atılmış en kapsamlı adım olarak küresel bir mihenk taşı niteliğindedir. Yasanın temel amacı, birbiriyle çelişkili gibi görünen iki hedef arasında hassas bir denge kurmaktır: Bir yanda, bu güçlü teknolojiyi "evcilleştirerek" insan hakları, güvenlik ve temel özgürlükler üzerindeki etkilerini hukuki bir güvence altına almak; diğer yanda ise, pazarın inovasyon motivasyonunu canlı tutarak teknolojik büyüme ve gelişmeyi teşvik etmek.

Bu analiz, Yapay Zekâ Yasası'nın felsefi temellerini, düzenleyici omurgasını oluşturan risk odaklı yapısını ve AB'ye aday ülke konumundaki Türkiye için doğuracağı potansiyel sonuçları derinlemesine incelemektedir.

Yasanın teknik hükümlerine geçmeden önce, bu düzenlemenin altında yatan felsefi ve etik dayanakları anlamak, metnin ruhunu kavramak açısından kritik bir öneme sahiptir.

AB Yapay Zekâ Yasası, yalnızca teknik kurallar bütünü olmanın ötesinde, etik normlar ve temel prensipler üzerine kurulu bütünsel bir ekosistem tasarımı sunmaktadır.

Yasanın hukuki dayanağını doğrudan Avrupa İnsan Hakları Bildirgesi'ne dayandırması, düzenlemenin merkezine teknolojiyi değil, insanın biricikliğini ve önceliğini koyduğunun en stratejik göstergesidir.

Bu felsefi çerçeve, üç temel ilke üzerine inşa edilmiştir:

Bu ilke, teknolojinin gelişim sürecinde "insanın öncülüğü" ve "insan gözetimi" prensiplerini mutlak bir zorunluluk olarak kabul eder. Yasaya göre yapay zekâ sistemleri, insana hizmet eden birer araç olarak kalmalı ve nihai kontrol daima insanda olmalıdır. Yasanın nihai hedefi, "teknolojiye karşı insan varlığının korunarak yüceltilmesi" olarak tanımlanmıştır.

Bu, teknolojinin insan özerkliğini, onurunu veya haklarını aşındırmasına izin verilmeyeceğine dair açık bir taahhüttür.

Yapay zekâ sistemlerinin hem teknik olarak güvenli bir sistem kurma zorunluluğu hem de sonuçları itibarıyla "güvenilir" olma şartı bulunmaktadır. Güvenilirlik ilkesi, sadece teknik sağlamlığı değil, aynı zamanda sistemin adil, öngörülebilir ve şeffaf çalışmasını da kapsar.

Noform Academy'nin AB Yapay Zeka Yasası ile Strateji Kurmak - Doç. Dr. Aslı Deniz Helvacıoğlu | DLA 2026 yayınında bu konuları detaylı olarak anlatan Doç. Dr. Aslı Deniz Helvacıoğlu'na göre bu ilke, aynı zamanda bir "hakkaniyet" arayışını da içermelidir; yani sistemlerin sadece doğru değil, aynı zamanda adil, merhametli ve eşitlikçi çıktılar üretmesi hedeflenmelidir.

Yasa, kanun koyucuya "insanın teknoloji karşısındaki konumunu koruma ve güçlendirme" yönünde proaktif bir yükümlülük getirmektedir. Bu koruyucu yaklaşım, teknolojinin potansiyel zararlarına karşı temkinli bir duruşu beraberinde getirir.

Yasanın yer yer "aşırı evhamlı" olarak nitelendirilebilecek ve riskleri minimize etmeyi önceleyen yapısı, bu temel koruyuculuk ilkesinden kaynaklanmaktadır. Bu proaktif koruma ilkesinin en net yansıması, yasanın belirli yapay zekâ uygulamalarını "Kabul Edilemez Risk" olarak tanımlayıp kesin bir dille yasaklamasında görülmektedir.

Bu üç temel ilke, yasanın en somut düzenleyici aracı olan risk temelli sınıflandırma yaklaşımına felsefi bir zemin hazırlamaktadır.

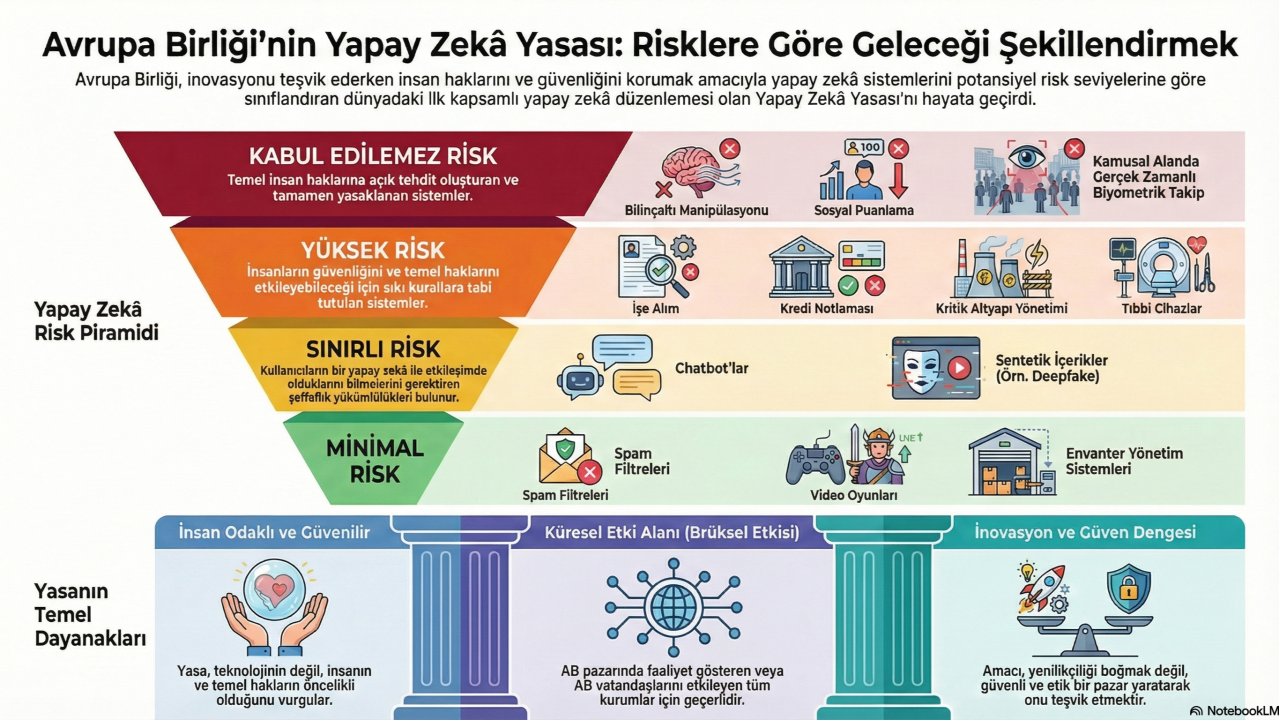

Yapay Zekâ Yasası, tüm yapay zekâ uygulamalarına tek tip bir kural seti uygulamak yerine, uygulamaları bireyler ve toplum için oluşturdukları potansiyel zararlara göre sınıflandıran stratejik bir yaklaşım benimser.

Yasa, riski "bir zararın meydana gelme olasılığı ile bu zararın ciddiyetinin birleşimi" olarak tanımlar. Bu yaklaşım, düzenleyici yükü en tehlikeli alanlara odaklayarak, düşük riskli alanlarda inovasyonun önünü açık bırakmayı hedefler. Sınıflandırma dört ana kategoride yapılır:

Bu kategori, temel insan hakları ve AB değerleri için açık bir tehdit olarak görülen ve bu nedenle pazarda yer alması tamamen yasaklanmış uygulamaları içerir. Bu uygulamalardan bazıları şunlardır:

- Devletler tarafından yürütülen genel amaçlı sosyal puanlama sistemleri.

- Bilinçaltı manipülasyonu teknikleri; bir başka deyişle, bir kişinin farkında olmadan davranışını değiştirmeyi hedefleyen her türlü uygulama.

- Çocuklar veya engelliler gibi savunmasız durumdaki grupların zaaflarını istismar eden yapay zekâ sistemleri.

- Öngörücü polislik sistemleri; yani bir kişinin sadece profiline veya kişilik özelliklerine dayanarak suç işleme potansiyelini değerlendirip onu suçlu varsayan uygulamalar.

Bu kategorideki yapay zekâ uygulamaları, doğaları gereği yüksek zarar üretme potansiyeline sahiptir ancak tamamen yasaklanmamıştır. Pazarda yer almalarına ancak sıkı regülasyonlar, şeffaflık kuralları ve raporlama yükümlülüklerine tam uyum sağlamaları koşuluyla izin verilir.

Bankacılık sektöründeki kredi skorlamaları, sigortacılık poliçeleri ve sağlık alanında kullanılan teşhis sistemleri bu kategorinin tipik örnekleridir.

Bu kategoride yer alan yapay zekâ sistemleri, genellikle düşük riskli inovasyonların önünü açar. Bu tür sistemler için temel beklenti, kullanıcıların bir yapay zekâ ile etkileşimde olduklarını bilmelerini sağlayan şeffaflık yükümlülükleridir.

Video oyunları veya spam filtreleri gibi göz ardı edilebilecek düzeyde, en düşük potansiyel zarara sahip uygulamalar bu kategoriye girer. Yasa, bu alandaki inovasyonu serbest bırakarak herhangi bir ek yasal yükümlülük getirmez.

Risk temelli bu pragmatik yaklaşım, yasanın katı yasaklar ile inovasyon teşviki arasındaki dengeyi kurma çabasının en somut örneğidir.

Yapay Zekâ Yasası'nın en temel hedeflerinden biri, "hakları koruyup riskleri minimize ederken, büyüme ve gelişmeyi doğru bir dengede tutmaktır." Yasa, katı kuralların teknolojik ilerlemeyi ve rekabetçiliği engellememesi için bilinçli olarak tasarlanmış mekanizmalar içerir. Bu denge, iki temel strateji üzerinden kurulur:

Risk Temelli Sınıflandırmanın Rolü: Yasanın düzenleyici kapsamını, potansiyel zararın büyüklüğüne göre en riskli alanlara odaklaması, bilinçli bir tercihtir. Bu sayede kısıtlı ve minimal risk taşıyan alanlarda faaliyet gösteren girişimciler, ağır bürokratik yükümlülükler olmaksızın rekabetçi ve yenilikçi bir oyun alanına dahil olma özgürlüğüne sahip olur.

Düzenleyici Deney Alanları (Regulatory Sandbox): Yasa, inovasyonu ön yargıyla yasaklamak yerine, onu kontrollü bir ortamda anlamayı ve yönlendirmeyi hedefler. "Düzenleyici Deney Alanları", girişimcilerin ve düzenleyici kurumların yeni iş modellerini yasal çerçeve içinde "izleyerek ve deneysel olarak gözlemleyerek" test etmelerine olanak tanır. Bu mekanizma, hem inovasyonun önünü açar hem de politika yapıcıların kanıta dayalı kararlar almasını sağlar.

Yasa, inovasyonu teşvik ederken dahi temel hak ve özgürlüklerden taviz vermez. İnsan onurunu ihlal eden, manipülatif potansiyel taşıyan veya ayrımcılığa yol açan belirli uygulamaları kesin bir dille yasaklayarak net kırmızı çizgiler çeker. Bu yasaklar, inovasyonun başıboş bir güç olmasını engelleyerek onu "sorumlu, insani ve sosyal refah toplumuna katkıda bulunan bir araç" haline getirme amacına hizmet eder.

Bu dengeleyici yaklaşımın yasal olarak ne zaman ve nasıl hayata geçeceği, Türkiye gibi AB'ye aday ülkeler için de önemli hukuki sonuçlar doğuracaktır.

Yapay Zekâ Yasası, sadece AB üyesi ülkeler için değil, "sınırlar ötesi hukuki uygulama esasları" getirmesi nedeniyle Türkiye gibi aday ülkeler için de doğrudan bağlayıcı sonuçlar doğuracaktır. Bu nedenle, yasanın yürürlük takvimini ve getireceği yükümlülükleri yakından takip etmek stratejik bir önem taşımaktadır.

- Ağustos 2024 - Kanunun ilk aşamalı yürürlüğe giriş başlangıcı.

- Ağustos 2026 sonrası - Üretken yapay zekâ gibi açık büyük sistemlere yönelik hükümlerin yürürlüğe girmesi ve firmaların yükümlülüklerinin başlaması.

- 2027 sonu - Yasanın tamamen yürürlüğe girmesi.

Türkiye'nin AB aday ülkesi statüsü, AB müktesebatına uyum sürecini de beraberinde getirmektedir. Bu nedenle, Yapay Zekâ Yasası'nın Türkiye'ye "hemen hemen kelimesi kelimesine benzer bir şekilde" uyarlanarak ulusal mevzuat haline gelmesi kuvvetle muhtemeldir.

Bu durum, AB pazarına ürün veya hizmet sunan Türk şirketleri başta olmak üzere, yapay zekâ geliştiren veya kullanan tüm kamu ve özel sektör kuruluşları için önemli hazırlıklar gerektirecektir. Şirketlerin, kullandıkları yapay zekâ sistemlerinin risk sınıflandırmasını yapmaları, yüksek riskli sistemler için gerekli şeffaflık ve raporlama altyapılarını kurmaları ve yasaklı uygulamalardan kaçınmaları kritik olacaktır.

Tüm bu analizler, AB Yapay Zekâ Yasası'nın hem küresel teknoloji yönetişimi hem de Türkiye'nin yasal geleceği için ne kadar belirleyici olduğunu göstermektedir.

Avrupa Birliği Yapay Zekâ Yasası, teknolojinin sunduğu fırsatları insan onuru ve temel haklar süzgecinden geçiren bütünsel bir yaklaşım sunmaktadır. İnsanı merkeze alan felsefi ilkeleri, düzenleyici yükü en riskli alanlara odaklayan pragmatik sınıflandırması ve inovasyonu kontrollü bir şekilde teşvik eden mekanizmalarıyla bu yasa, koruma ve gelişme arasındaki hassas dengeyi kurmaya çalışan modern bir hukuki çerçevedir.

Küresel yapay zekâ düzenlemeleri için bir standart belirleme potansiyeli taşıyan bu yasanın getireceği dönüşümlere Türkiye'nin şimdiden hazırlıklı olması, hem hukuki uyum sağlamak hem de küresel rekabette geride kalmamak adına stratejik bir zorunluluktur.

Daha detaylı örnekler ve görselleştirilmiş anlatım için hazırlanan videoya göz atabilirsiniz: